作者:Vincent Jow

编译:1912212.eth,Foresight News

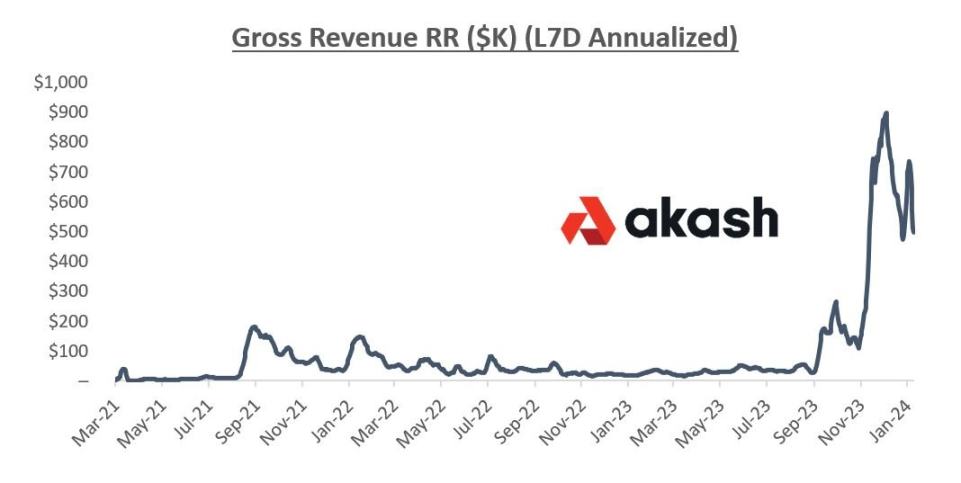

总结Akash 是去中心化计算平台,旨在连接未充分利用的 GPU 供应与需要 GPU 计算的用户,目标是成为 GPU 计算的「Airbnb」。与其他竞争对手不同,它们主要专注于通用、企业级 GPU 计算。2023 年 9 月推出 GPU 主网后,它已在其网络上拥有 150-200 个 GPU,利用率达到 50-70%,年总交易价值为 50 万美元至 100 万美元。与互联网市场相一致,Akash 对 USDC 支付收取 20% 的交易费。

我们正处于基础设施的巨大变革之初,由 GPU 驱动的并行处理正在崛起。预计人工智能将使全球 GDP 增加 7 万亿美元,同时使 3 亿个工作岗位实现自动化。而制造 GPU 的英伟达,预计其营收将从 2022 年的 270 亿美元增至 2023 年的 600 亿美元,到 2025 年将达到约 1000 亿美元。云计算厂商(AWS、GCP、Azure 等)在英伟达芯片上的资本支出已从个位数增长到如今的 25%,预计在未来几年将达到 50% 以上。(来源:Koyfin)

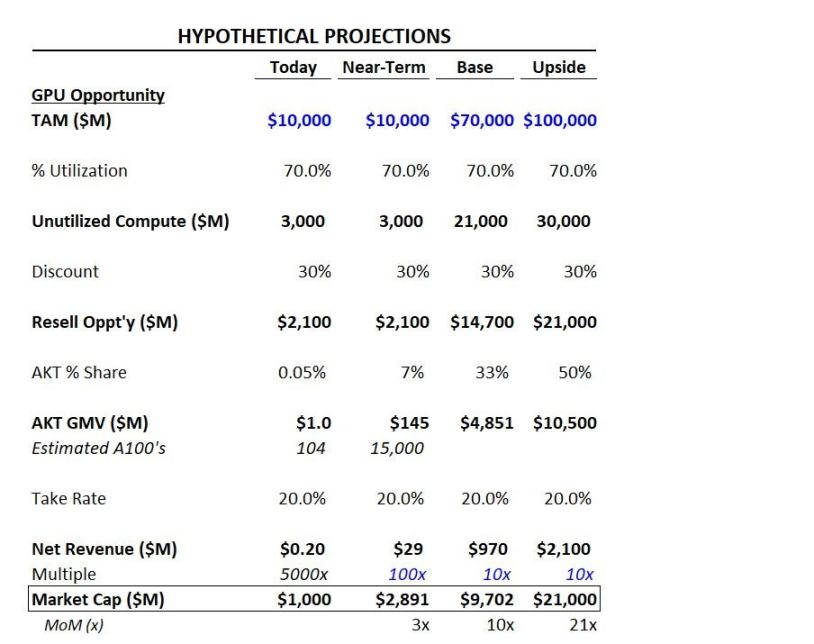

摩根斯坦利估计,到 2025 年,超大规模 GPU 基础设施即服务(IaaS)的机会将达到 400-500 亿美元。作为例证,如果将 30% 的 GPU 计算通过二级市场以 30% 的折扣转售,这将是一个 100 亿美元的营收机会。再加上来自非超大规模来源的另一个 50 亿美元的营收机会,总共将是 150 亿美元的营收机会。假设 Akash 能够占据这个机会的 33% 市场份额(50 亿美元的总交易价值),并以 20% 的交易费率,这将转化为 10 亿美元净营收。应用一个 10 倍的倍数,将产生一个接近 100 亿美元的市值结果。

市场概况2022 年 11 月,OpenAI 推出 ChatGPT,创下了最快的用户基数增长纪录,到了 2023 年 1 月,达到 1 亿用户,到 5 月达到 2 亿用户。这带来的影响是巨大的,估计通过提高生产力和自动化 300 万个工作岗位,将使全球 GDP 增加 7 万亿美元。

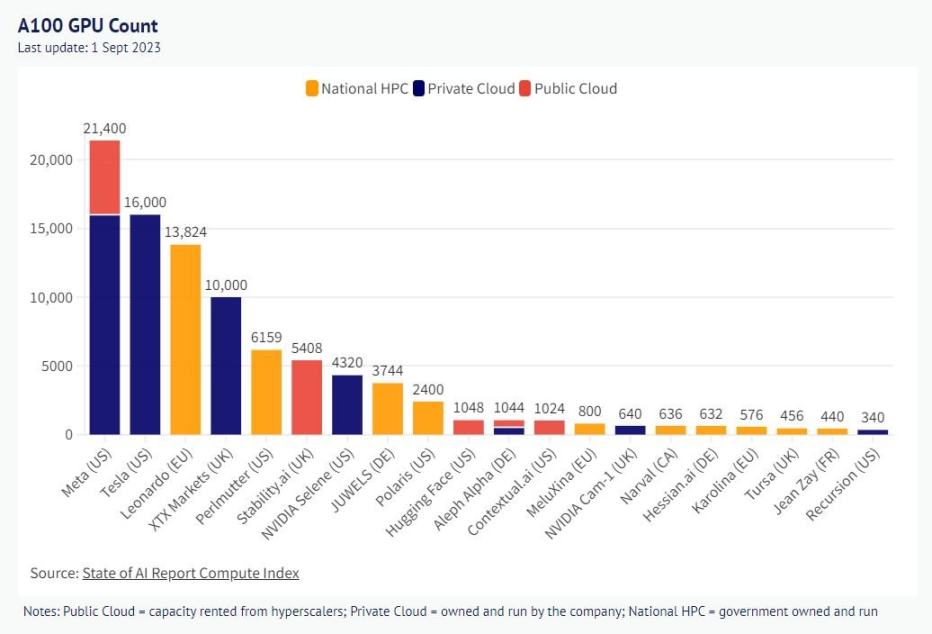

人工智能迅速从研发的一个小众领域崛起为公司最大的支出重点。创建 GPT-4 的成本为 1 亿美元,年运行成本为 2.5 亿美元。GPT-5 需要 25,000 个 A100(相当于 2.25 亿美元的 Nvidia 硬件)和可能需要 10 亿美元的总硬件投资。这在公司之间掀起了一场争夺足够 GPU 以支持人工智能为驱动的企业工作负载的军备竞赛。

这场人工智能革命引发了基础设施的巨变,加速了从 CPU 到 GPU 并行处理的转变。历史上,GPU 一直被用于同时大规模渲染和处理图像,而 CPU 则设计为串行运行,无法同时进行这样的操作。由于高内存带宽,GPU 逐渐演变为处理其他具有并行问题的计算,例如训练、优化和改进人工智能模型。

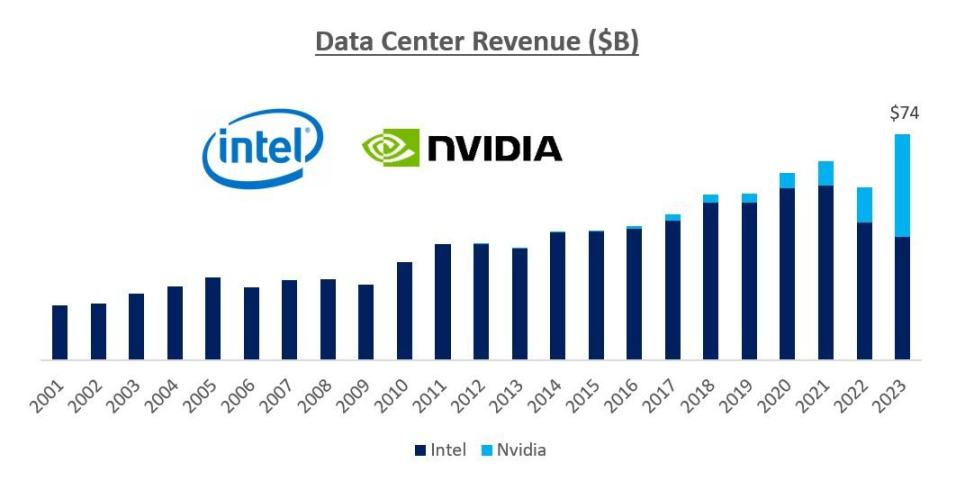

在上世纪 90 年代首创 GPU 技术的 Nvidia,将其一流的硬件与 CUDA 软件堆栈相结合,建立了与竞争对手(主要是 AMD 和英特尔)相比的多年领先地位。Nvidia 的 CUDA 堆栈于 2006 年开发,允许开发人员优化 Nvidia GPU 以加速其工作负载并简化 GPU 编程。有 400 万 CUDA 用户,超过 50,000 名开发人员正在使用 CUDA 进行开发,拥有强大的编程语言、库、工具、应用程序和框架生态系统。我们预计随着时间的推移,Nvidia GPU 将在数据中心中超越英特尔和 AMD CPU。

超大规模云服务提供商和大型科技公司对 Nvidia GPU 的支出迅速增加,从 2010 年初的低水平个位数百分比占比,到 2015 年 -2022 年的中等个位数占比,再到 2023 年的 25%。我们认为,在未来几年内,Nvidia 将占据云服务提供商资本支出的 50% 以上。这有望推动 Nvidia 的营收从 2022 年的 250 亿美元增至 2025 年的 1,000 亿美元(来源:Koyfin)。

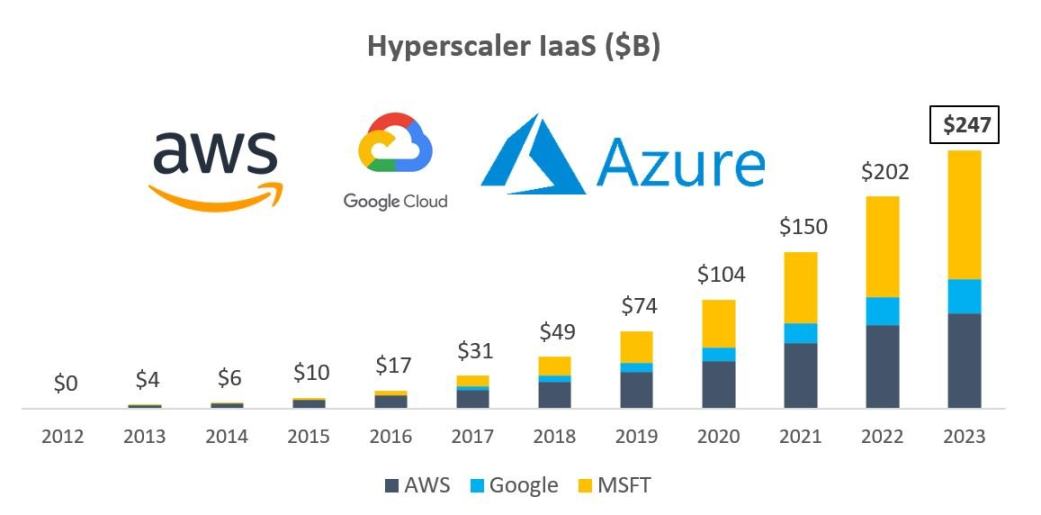

摩根斯坦利估计,到 2025 年,超大规模云服务提供商的 GPU 基础设施即服务(IaaS)市场规模将达到 400-500 亿美元。这仍然只是超大规模云服务提供商总营收的一小部分,目前排名前三的超大规模云服务提供商今天的总营收约为 2500 亿美元以上。

鉴于对 GPU 的强烈需求,GPU 供应短缺现象已被《纽约时报》和《华尔街日报》等媒体广泛报道。AWS 首席执行官表示「需求超过了供应,对每个人都是如此」。埃隆·马斯克在 2023 年第二季度特斯拉收益电话会议上表示「我们将继续使用——我们会尽快地收到 Nvidia 的硬件」。

Index Ventures 不得不为其投资组合公司购买芯片。主流科技公司之外,几乎不可能从 Nvidia 购买到芯片,而从超大规模云服务提供商那里获取芯片也需要很长时间。

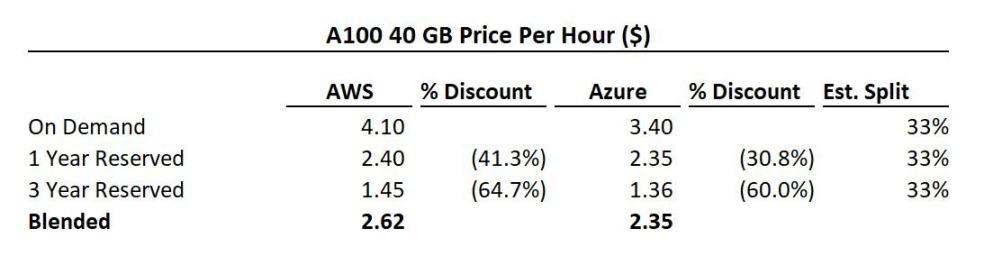

以下是 AWS 和 Azure 的 GPU 定价情况。如下所示,预订 1-3 年可获得 30-65% 的折扣。由于超大规模云服务提供商正在投资数十亿美元用于扩大容量,因此他们正在寻找能够提供收入可见性的投资机会。如果客户预计利用率超过 60%,最好选择支付 1 年的预留定价,如果预计利用率超过 35%,则选择 3 年。任何未使用的容量都可以重新销售,从而大幅降低其总成本。

如果超大规模云服务提供商构建了一个价值 500 亿美元的 GPU 计算租赁业务,那么重新销售未使用的计算能力将是一个巨大的机会。假设有 30% 的计算能力以 30% 的折扣重新销售,那就是一个价值 100 亿美元的市场,重新销售超大规模云服务提供商的 GPU 计算能力。

然而,除了超大规模云服务提供商之外,还有其他供应来源,包括大型企业(例如 Meta、特斯拉)、竞争对手(CoreWeave、Lambda 等)以及资金充裕的人工智能初创公司。从 2022 年到 2025 年,Nvidia 将创造约 3000 亿美元的营收。假设在超大规模云服务提供商之外还有 700 亿美元的芯片,以 20% 的计算能力以 30% 的折扣重新销售,这将为其增加另外 100 亿美元,总计 200 亿美元。

Akash 概览Akash 是一个去中心化计算市场,成立于 2015 年,于 2020 年 9 月作为 Cosmos 应用链推出主网。其愿景是通过提供价格显著低于超大规模云服务提供商的未充分利用的计算资源,实现云计算的民主化。

该区块链处理协调和结算,存储请求、竞标、租赁和结算的记录,而执行是在链下完成的。Akash 托管容器,用户可以在其中运行任何云原生应用程序。Akash 构建有一套云管理服务,包括 Kubernetes 来编排和管理这些容器。部署是从一个与区块链隔离的私人点对点网络转移的。

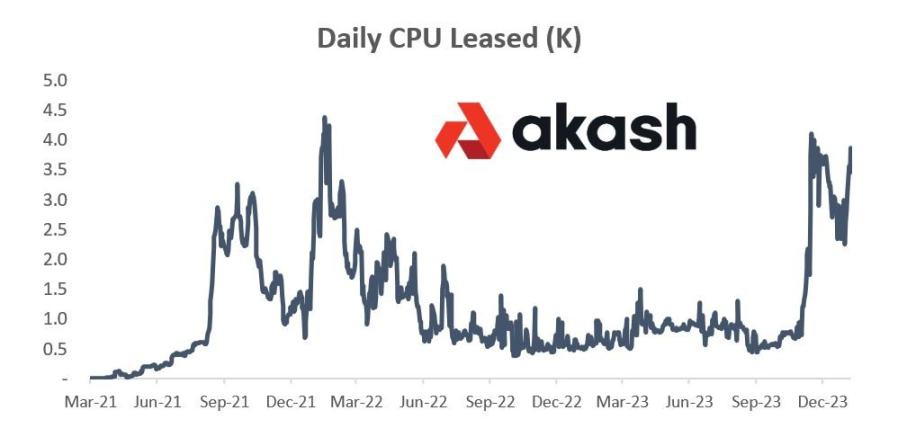

Akash 的第一版专注于 CPU 计算。在其巅峰时期,该业务的年度总交易额达到了约 20 万美元,租赁了 4-5 千个 CPU。然而,存在两个主要问题,即入门难度(需要启动一个 Cosmos 钱包并使用 AKT 代币支付工作负载)和客户流失(必须为钱包充值 AKT,如果 AKT 用完或价格变动,工作负载将停止,没有备用提供商)。

在过去的一年里,Akash 已经从 CPU 计算转变为 GPU 计算,利用了计算基础设施和供应短缺的这一范式转变。

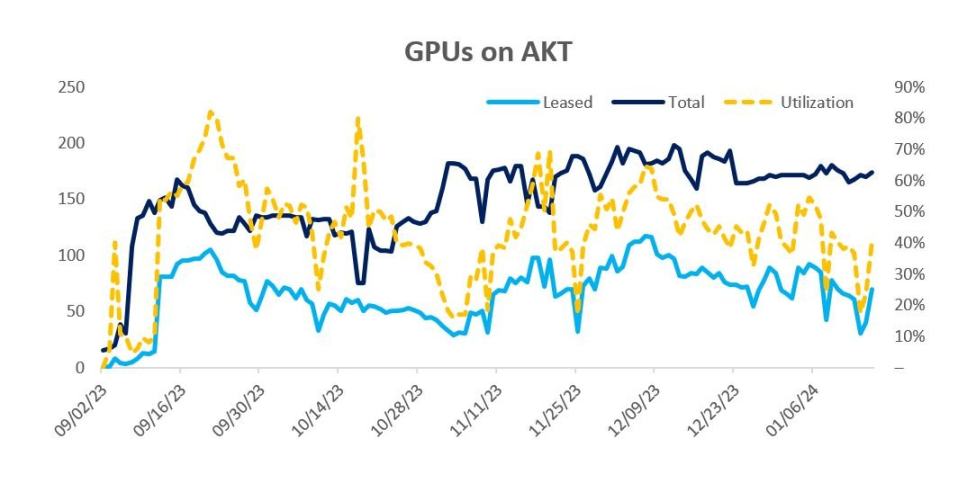

Akash 的 GPU 网络于 2023 年 9 月在主网上线。从那时起,Akash 已经扩展到 150-200 个 GPU,利用率达到 50-70%。

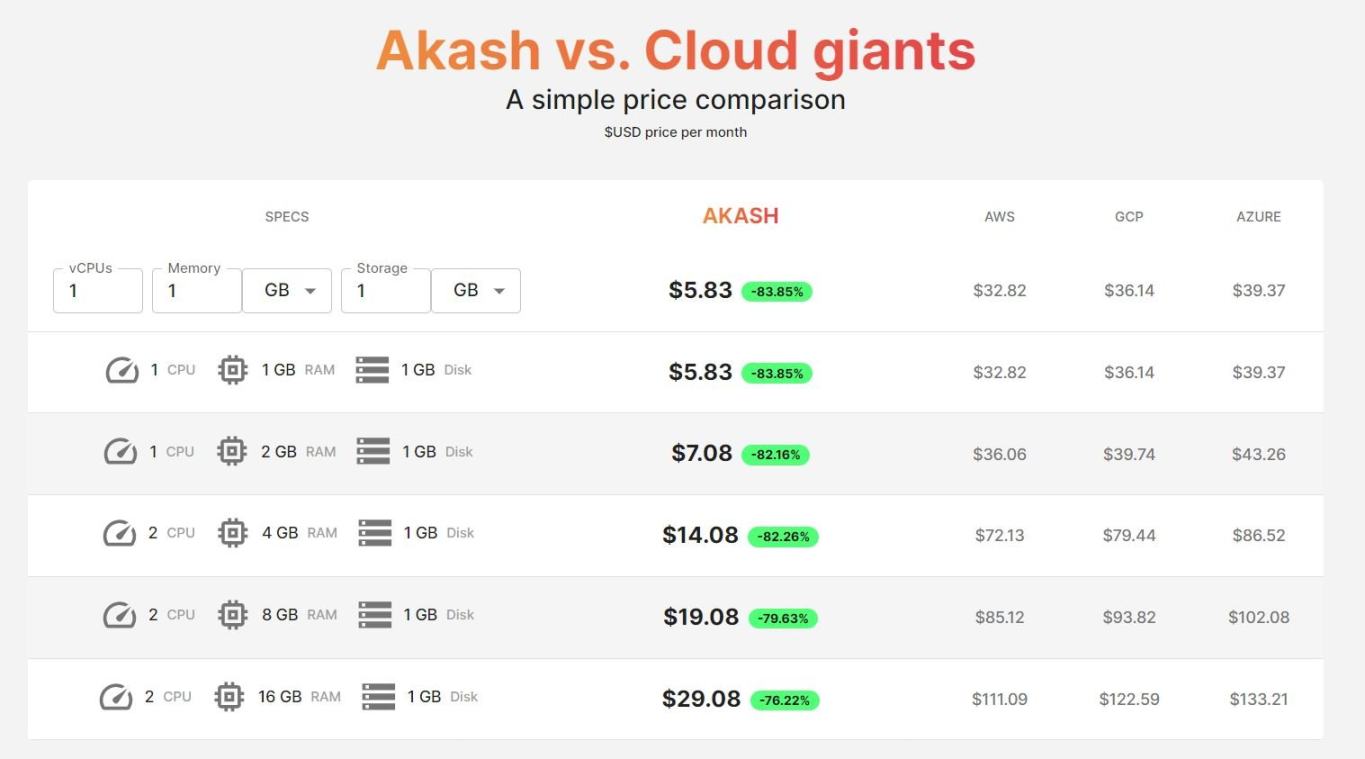

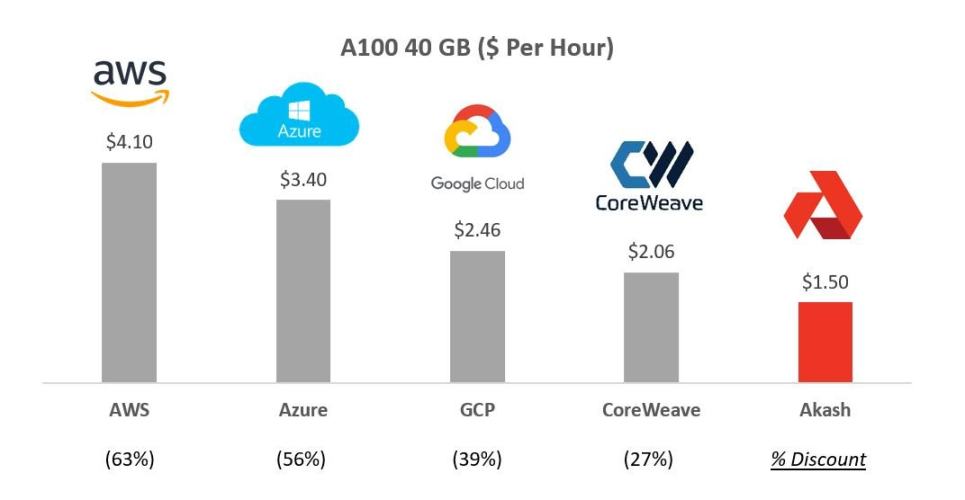

以下比较了几家提供商的 Nvidia A100 价格,Akash 的价格比竞争对手便宜 30-60%。

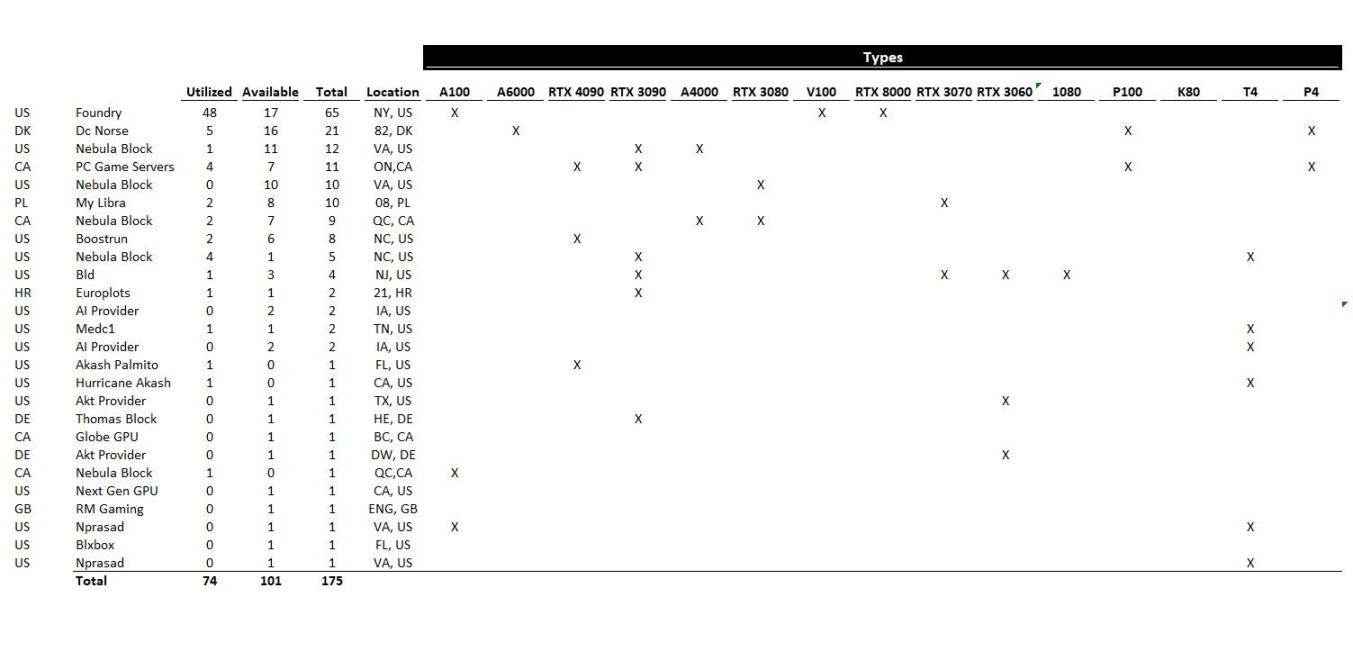

在 Akash 网络上有大约 19 个独特的提供商,分布在 7 个国家,供应超过 15 种类型的芯片。最大的提供商是 Foundry,这是一家由 DCG 支持的公司,也从事加密挖矿和权益质押。

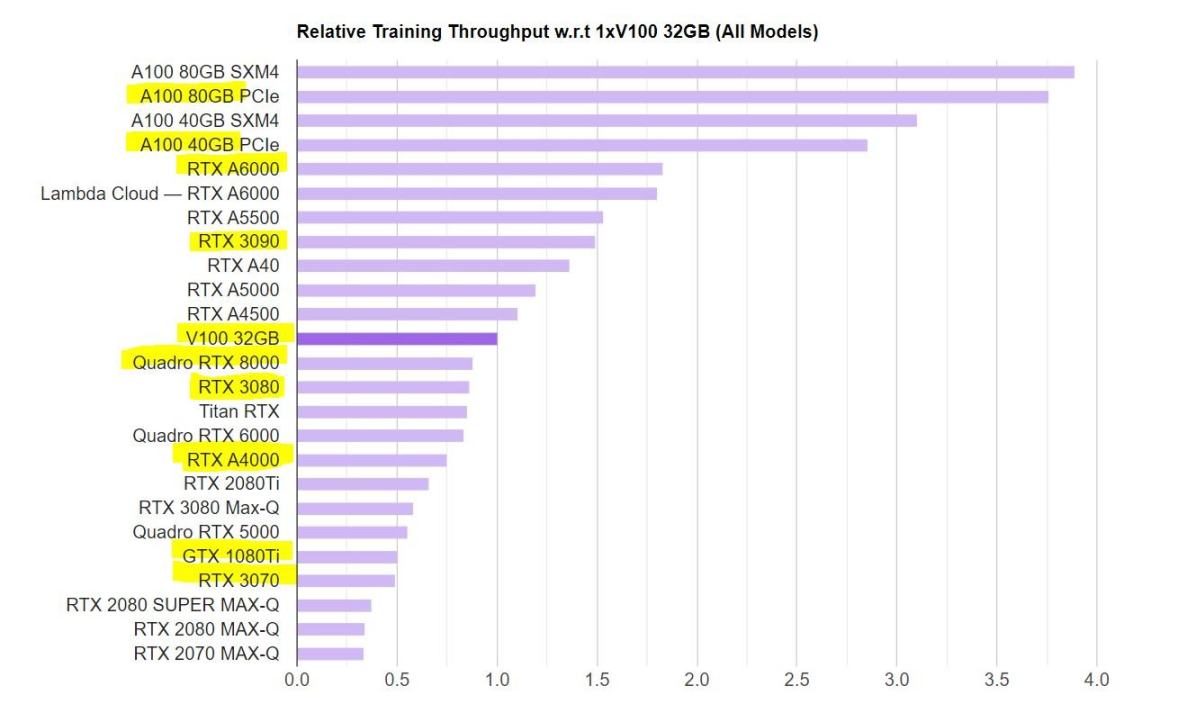

Akash 主要专注于企业级芯片(A100),这些芯片传统上用于支持 AI 工作负载。虽然他们也提供了一些消费级芯片,但由于功耗、软件和延迟问题,这些芯片在过去通常难以用于 AI。有几家公司如 FedML、io.net 和 Gensyn,正在尝试构建一个编排层,以实现 AI 边缘计算。

随着市场越来越多地转向推断而非训练,消费级 GPU 可能变得更具可行性,但目前市场主要集中在使用企业级芯片进行训练。

在供应方面,Akash 专注于公共超大规模云服务提供商、私人 GPU 提供商、加密矿工和持有未充分利用 GPU 的企业。

超大规模公有云服务提供商:最大的潜力是让超大规模公有云服务提供商(Azure、AWS、GCP)允许他们的客户在 Akash 市场上转售未充分利用的容量。这将使他们能够获得资本投资的收入可见性。一旦一个超大规模云服务提供商允许这样做,其他人可能也需要跟进,以保持竞争份额。正如前面提到的,超大规模云服务提供商可能会有一个 500 亿美元的基础设施即服务(IaaS)机会,为 Akash 的市场创造了一个大规模的二手交易机会。私有云竞争对手:除了超大规模公有云服务提供商外,还有几家私有云公司(CoreWeave、Lambda Labs 等)也提供 GPU 租赁服务。鉴于超大规模云服务提供商试图构建自己的 ASIC 作为替代硬件的竞争动态,Nvidia 已经向一些私有公司提供了更多的供应。私有竞争对手的定价通常比超大规模云服务提供商更便宜(例如,A100 便宜多达 50%)。CoreWeave 是最知名的私有竞争对手之一,曾经是一家加密挖矿公司,于 2019 年转变为建造数据中心并提供 GPU 基础设施。它正在以 70 亿美元的估值进行融资,并得到 Nvidia 的支持。CoreWeave 正在迅速增长,2023 年收入达到 5 亿美元,预计 2024 年收入将达到 15-20 亿美元。CoreWeave 拥有 4.5 万块 Nvidia 芯片,估计这些私人竞争对手总共可能拥有 10 万多个 GPU。为他们的客户群体启用二级市场可能使这些私人竞争对手在与公共超大规模云服务提供商的竞争中获得份额。加密矿工:加密矿工历来是 Nvidia GPU 的大量消费者。由于解决密码证明的计算复杂性,GPU 已经成为工作量证明网络的主导硬件。随着以太坊从工作量证明转变为权益证明,这导致了大量的过剩产能。据估计,解放出来的芯片约有 20% 可以用于重用于 AI 工作负载。此外,比特币矿工也希望实现收入多元化。在过去的几个月中,Hut 8、Applied Digital、Iris Energy、Hive 和其他比特币矿工都宣布了人工智能 / 机器学习战略。在 Akash 上最大的供应商是 Foundry,它是最大的比特币矿工之一。企业:正如之前所示,Meta 拥有大量 GPU,拥有 15,000 个 A100,利用率为 5%。同样,特斯拉也有 15,000 个 A100。企业计算的利用率通常低于 50%。鉴于这一领域的大量风险投资,许多 AI/ML 初创公司也提前购买了芯片。能够转售未使用的容量将降低这些较小公司的总拥有成本。有趣的是,租赁旧 GPU 可能存在潜在的税收优势。Akash GPU 需求侧

2022 年和 2023 年大部分时间,在 GPU 网络推出之前,CPU 的年化总值(GMV)约为 5 万美元。自 GPU 网络推出以来,GMV 已经达到 500,000 至 1,000,000 美元的年化水平,GPU 网络上的利用率为 50-70%。

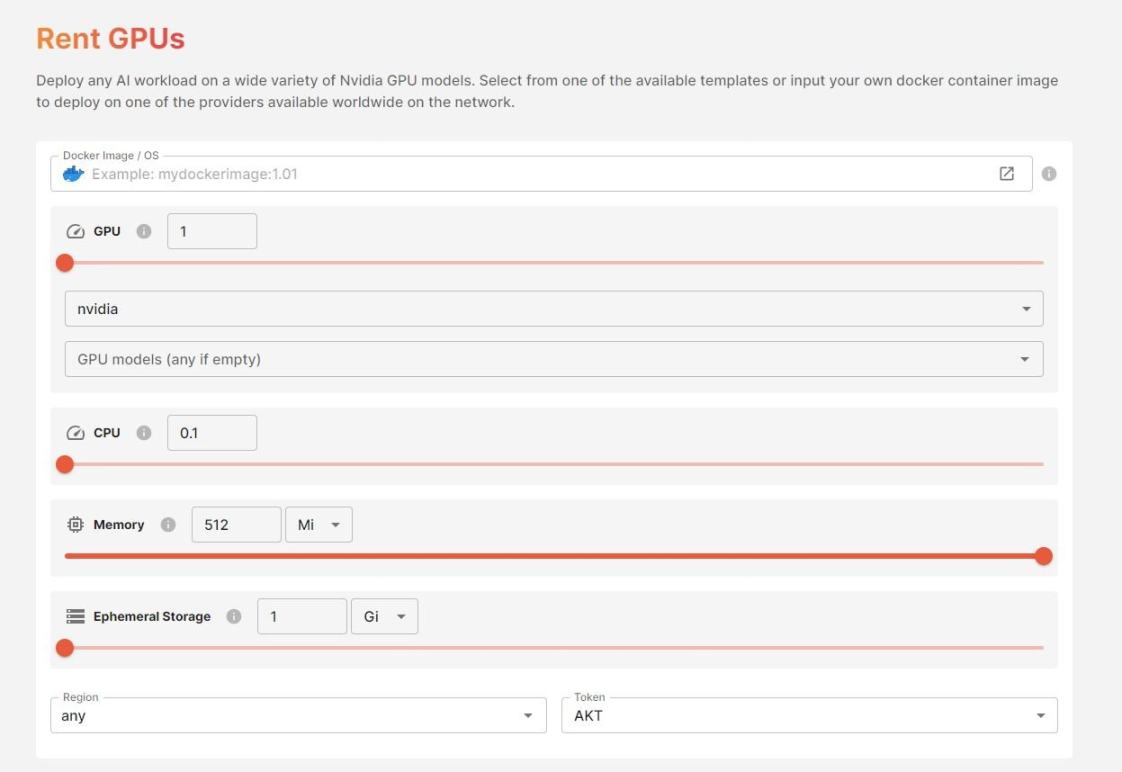

Akash 一直在努力减少用户摩擦、改善用户体验和拓宽用例。

USDC 支付:Akash 最近允许使用 USDC 进行稳定支付,使客户不再受到购买 AKT 和持有 AKT 直到支付时的价格波动影响。Metamask 钱包支持:Akash 还实施了 Metamask Snap,以便更轻松地进行入门,而不必创建一个特定于 Cosmos 的钱包。企业级支持:Akash 网络的创建者 Overclock Labs 推出了 AkashML,可以通过企业级支持更轻松地引入用户到 Akash 网络上。自助服务:Cloudmos 最近被 Akash 收购,还推出了一个易于使用的自助服务界面,用于部署 GPU。以前,部署必须通过命令行代码完成。选择:虽然重点主要放在 Nvidia 企业级芯片上,但 Akash 也提供消费级芯片,并且截至 2023 年底,已添加对 AMD 芯片的支持。Akash 还在通过网络验证用例。在 GPU 测试网络期间,社区展示了它可以使用网络部署和运行许多流行的 AI 模型的推理。Akash Chat 和 Stable Diffusion XL 应用程序都展示了 Akash 运行推理的能力。我们认为,随着时间的推移,推理市场将比培训市场大得多。今天 AI 驱动的搜索成本为 0.02 美元(是 Google 当前成本的 10 倍)。鉴于每年有 3 万亿次搜索,这将是每年 600 亿美元。为了将其置于上下文中,训练 OpenAI 模型的成本约为 1 亿美元。虽然这两者的成本可能都会降低,但这突显了长期收入池的显著差异。

考虑到今天对高端芯片的大多数需求都集中在培训方面,Akash 目前还在努力展示他们可以使用 Akash 网络来训练一个模型,并计划在 2024 年初推出该模型。在使用来自单一供应商的同质芯片之后,下一个项目将是使用来自多个供应商的异构芯片。

Akash 的路线图非常大。正在进行的一些产品功能包括隐私管理支持、按需 / 保留实例和更好的可发现性。

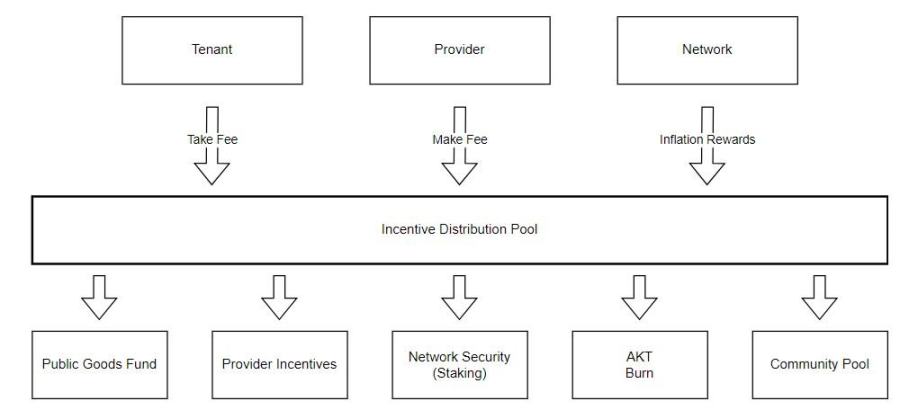

代币模型与激励Akash 对 AKT 支付收取 4% 手续费,对 USDC 支付收取 20% 手续费。这 20% 的收费率与我们在传统互联网市场上看到的类似(例如 Uber 的 30%)。

Akash 有大约 58% 的代币在流通(流通中有 2.25 亿,最大供应为 3.88 亿)。每年的通货膨胀率已从 8% 提高到 13%。目前,60% 的流通代币已被锁仓,锁仓期为 21 天。

40%(之前为 25%)的通货膨胀和 GMV 的收费率也会进入社区池,该社区池目前有 1000 万美元的 AKT 代币。

这些资金的用途仍在确定中,但将在公共资金、提供者激励、质押、潜在销毁和社区池之间进行分配。

在 1 月 19 日,Akash 启动了一个 500 万美元的试点激励计划,旨在将 1,000 个 A100 引入平台。随着时间的推移,目标是为参与市场的提供商提供供应端的收入可见性(例如 95% 的有效利用率)。

估值和场景分析以下是几种场景和 Akash 关键驱动因素的说明性假设:

短期情况:我们估计如果 Akash 能够达到 15,000 个 A100,这将产生近 1.5 亿美元的 GMV。以 20% 的抽成率计算,这将为 Akash 带来 3000 万美元的协议费用。考虑到增长轨迹,以 100 倍的倍数(考虑到 AI 的估值)计算,这将价值 30 亿美元。

基准情况:我们假设 IaaS 市场机会与摩根士丹利的估计一致,为 500 亿美元。假设 70% 的利用率,有 150 亿美元的可转售容量。假设这个容量打折 30%,得到 100 亿美元,加上其他非超级扩展源的 100 亿美元。鉴于市场通常享有强大的护城河,我们假设 Akash 能够实现 33% 的份额(Airbnb 度假租赁市场份额的 20%,Uber 共享乘车市场份额的 75%,Doordash 送餐市场份额的 65%)。以 20% 的抽成率计算,这将产生 10 亿美元的协议费用。以 10 倍的倍数计算,Akash 将成为 100 亿美元的结果。

上行情况:我们的上行情况使用与基准情况相同的框架。我们假设由于能够渗透更多独特的 GPU 来源以及在份额增长方面更高,产生 200 亿美元的转售机会。

背景信息,Nvidia 是一家市值 1.2 万亿美元的上市公司,而 OpenAI 在私募市场的估值为 800 亿美元,Anthropic 为 200 亿美元,CoreWeave 为 70 亿美元。在加密领域,Render 和 TAO 的估值分别为 20 亿美元和 55 亿美元以上。

风险与缓解措施:供应和需求的集中度: 当前,GPU 需求的大部分来自大型科技公司对训练极大、复杂的 LLM(大型语言模型)的需求。随着时间的推移,我们相信会有更多对训练规模较小的 AI 模型的兴趣,这些模型更便宜且更能处理私有数据。微调将变得越来越重要,因为模型从通用型转变为垂直特定型。最后,随着使用和采用的加速,推断将变得越来越关键。

竞争: 有许多加密和非加密公司试图释放未充分利用的 GPU。一些较为显著的加密协议有:

Render 和 Nosana 正在释放用于推断的消费级 GPU。Together 正在构建开源训练模型,允许开发者构建在其上。Ritual 正在构建托管模型的网络。延迟问题和技术挑战: 鉴于 AI 训练是一项非常资源密集的任务,考虑到所有芯片都位于一个数据中心,目前尚不清楚是否可以在去中心化的、非共同位置的 GPU 堆栈上训练模型。OpenAI 计划在亚利桑那州的一个地点建设拥有 75,000 多个 GPU 的下一个训练设施。这些都是 FedML、Io.net 和 Gensyn 等编排层试图解决的问题。